실리콘밸리의 논쟁

최근 실리콘밸리에서는

AI 무기가 생명을

결정할 수 있는지에 대한

논쟁이 일고 있습니다. 🛡️

Shield AI의 공동 창립자인

Brandon Tseng은

미국에서 무기가

완전히 자율적이지

않을 것이라고

확신했지만,

이 의견은

오래가지 않았습니다.

상반된 의견들

다섯 날 후,

Anduril의 공동 창립자

Palmer Luckey는

자율 무기에 대한

개방적인 태도를

보였습니다.

그는 “어디가 도덕적

우위인지 보라”며

자율 무기에 대한

비판에 대해

회의적인 시각을

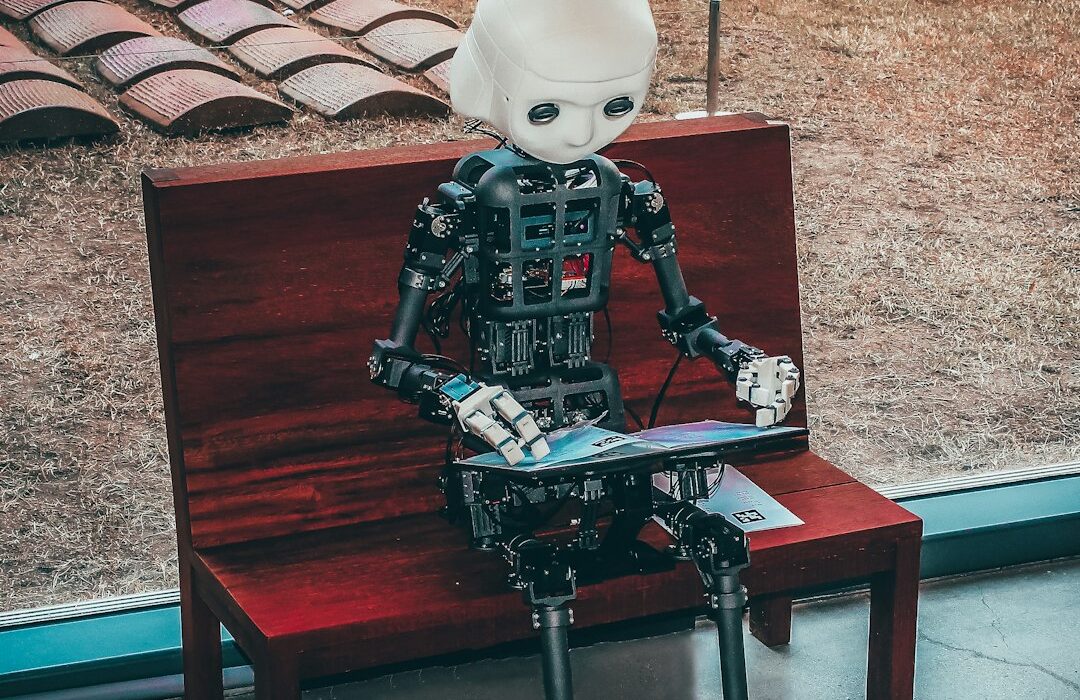

드러냈습니다. 🤖

한편,

Shannon Prior는

Luckey가 ‘나쁜 사람들이

나쁜 AI를

이용하는 것’에 대한

우려를 나타낸 것이라

설명했습니다.

미국의 모호한 입장

미국 정부의 입장도

모호합니다.

미국 군은 현재

완전 자율 무기를

구매하지 않지만,

완전 자율적인

치명적 무기를

개발하거나 판매하는 것을

명확히 금지하지도

않습니다.

작년에 미국은

AI 안전 가이드라인을

발표했지만,

이것은 자발적인

것이며,

현재로서는 구속력 있는

금지를 검토할

시기가 아니라고

밝혔습니다.

국제적 논의

우크라이나 전쟁은

자율 무기에 대한

국제적 논의에

영향을 미쳤습니다.

우크라이나는

더 많은 자동화를

요구하며,

이 기술이 승리를

위한 핵심이라고

밝혔습니다. 🕊️

러시아와 중국의

완전 자율 무기

출시 가능성은

미국의 대응을

촉구하고 있습니다.

결론

이 논쟁은 계속되고

있으며,

실리콘밸리의

기업들은 의회에

영향을 미치기 위해

로비 활동을

진행 중입니다.